Pour son spectacle l’Examen Moyak, l’Agence du Verbe a fait développer un outil de simulation informatique dédié à la diffusion binaurale collective.

L’étude a bénéficié d’une aide de la Région Bretagne, du Conseil Général des Côtes d’Armor, de la ville de Guingamp et du laboratoire d’audio 3D d’Orange Labs à Lannion. L’outil est désormais accessible à tous, gratuitement (liens de téléchargement en fin d’article]

Fusion audiovisuelle

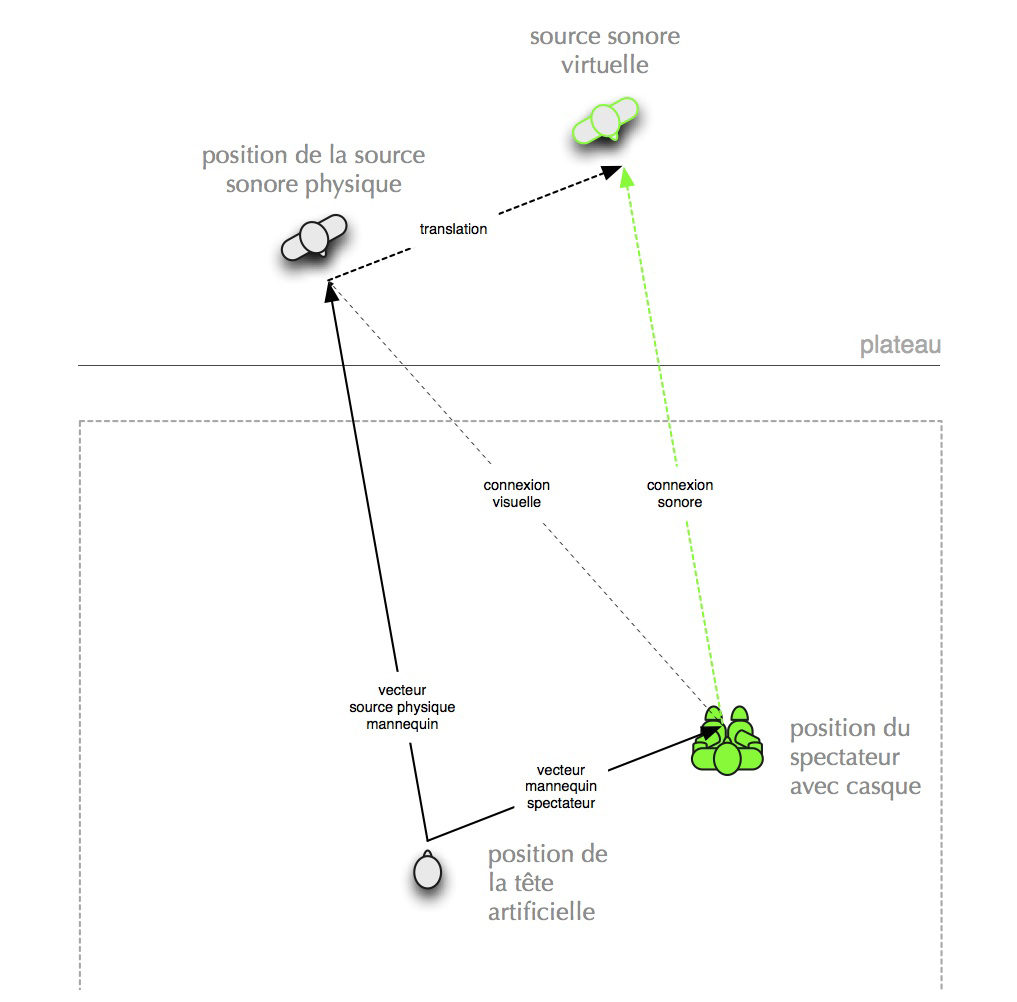

L’Examen Moyak fait interagir des scènes préenregistrées et des actions sur le plateau, captées en direct. Le public a une connexion visuelle directe avec la scène, mais la connexion sonore est fournie par le ou les mannequins de prise de son, donc avec un autre point de “vue” :

Là où je suis, je vois par moi-même, mais j’entends par l’oreille d’un autre, situé à un autre endroit. L’œil et l’oreille n’ont plus le même point de vue !

La réalisation doit donc composer avec une fenêtre de fusion variable.

La fenêtre d’intégration audiovisuelle est la faculté cognitive d’associer en temps réel un objet visuel à son corollaire sonore (percept unique) quand l’un et l’autre sont décalés dans l’espace (au cinéma, un visage au centre de l’image et sa voix à droite, par exemple). Dans la fenêtre d’intégration, les objets sont perçus associés, hors d’elle, ils sont perçus dissociés.

L’étude sert à doter la réalisation d’un outil de synthèse sur des questions peu documentées et doit aider à trouver des solutions dans l’écriture et la conduite du spectacle.

En pratique

Dans un premier temps, la sonographie s’appuyait sur l’idée de mettre le ou les mannequins de prise de son parmi le public, dans les gradins. Pour tester ce postulat de travail, il fallait évaluer la qualité de la connexion audiovisuelle du spectateur avec le plateau.

Une étude conduite au théâtre du Champ au Roy à Guingamp a permis de vérifier les hypothèses de départ. Il fallait observer à partir de quel angle les connexions visuelles et auditives ne paraissaient plus corrélées.

Comme il s’agissait de défricher, après quelques essais avec une source audiovisuelle artificielle, nous avons testé quatre sujets avec une voix au plateau. Notre but n’était pas d’être exhaustifs à ce stade, mais simplement de vérifier, grosso modo, si l’hypothèse de mettre un mannequin dans le public avait des chances de fonctionner.

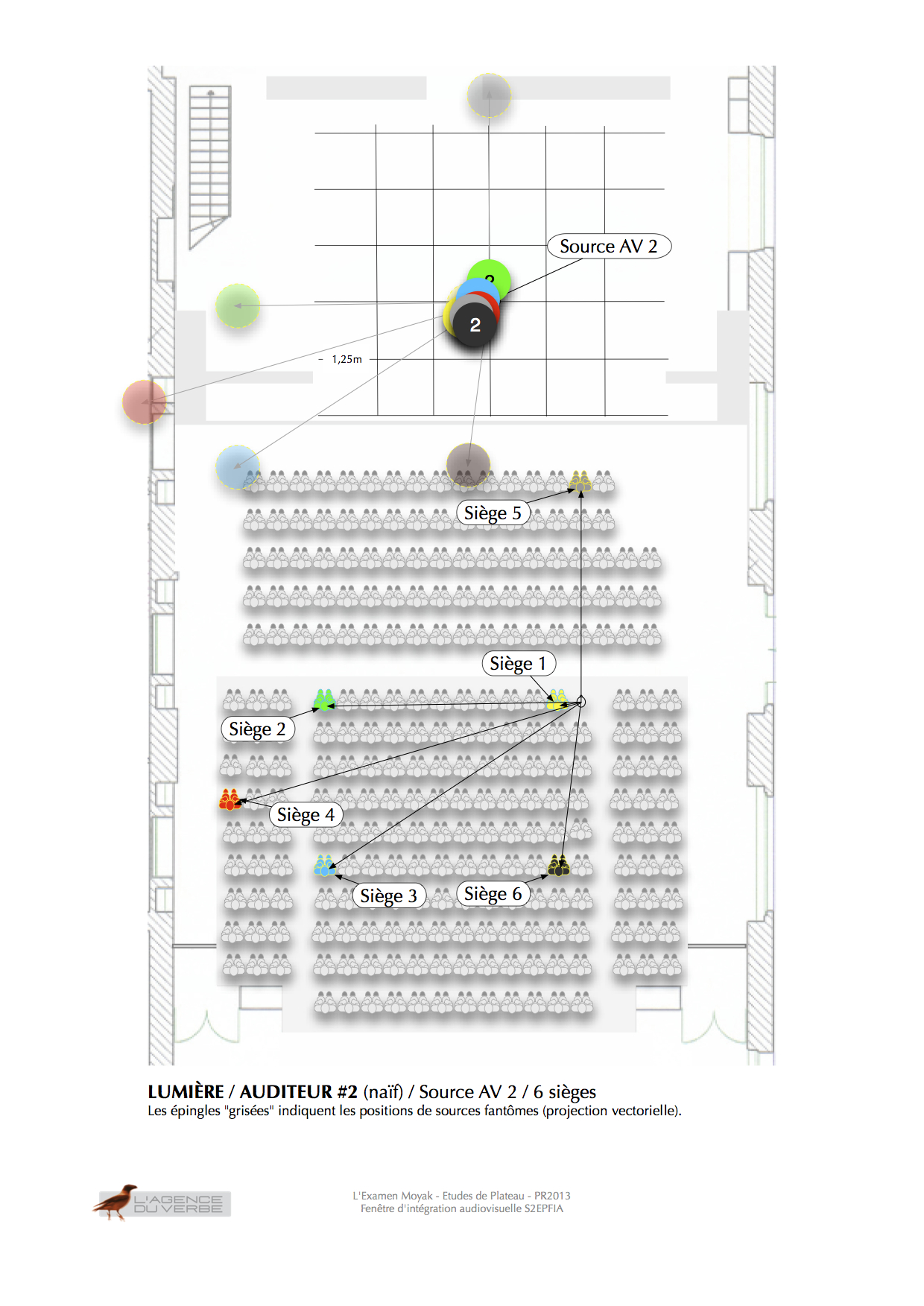

Sur cet exemple d’un relevé de test, les projections sonores déterminées par la relation géométrique entre la source réelle et le mannequin sont en couleurs adoucies. Les réponses de l’auditeur testé (ici un auditeur “non expert”) sont les pastilles de pleine couleur : sur ce relevé, elles sont “collées” sur l’emplacement de la source réelle.

Le sujet a déclaré “qu’il était captivé par la voix de l’actrice” et pour lui, le décalage angulaire n’empêchait jamais d’associer visuel et sonore. La connexion n’a pas paru si robuste pour les autres sujets : de l’ordre de 20 degrés avec une scène éclairée et de seulement 10 degrés dans le noir.

Le test a aussi montré des phénomènes de “magnétisme” : quand la projection sonore (la source virtuelle) est détachée de son corolaire visuel, elle peut, dans l’esprit du spectateur, se fixer sur d’autres “objets” physiques (porte, mur, haut-parleur, etc.), selon la nature des événements sonores.

La diversité des réponses, imputable au faible nombre de sujets testés (4) et aux limites de cette manip rapide, signale probablement quand même que le cognitif et l’émotionnel jouent un rôle important dans la reconstruction spatiale audiovisuelle.

Simulateur

Après les tests in vivo, il fallait percevoir un peu mieux la disparité de la connexion audiovisuelle dans le public. Quel pourcentage du public aurait une connexion correcte ? Ou mettre le ou les mannequins ? Comment utiliser la scène ? Fallait-il changer de postulat et mettre les mannequins ailleurs ?

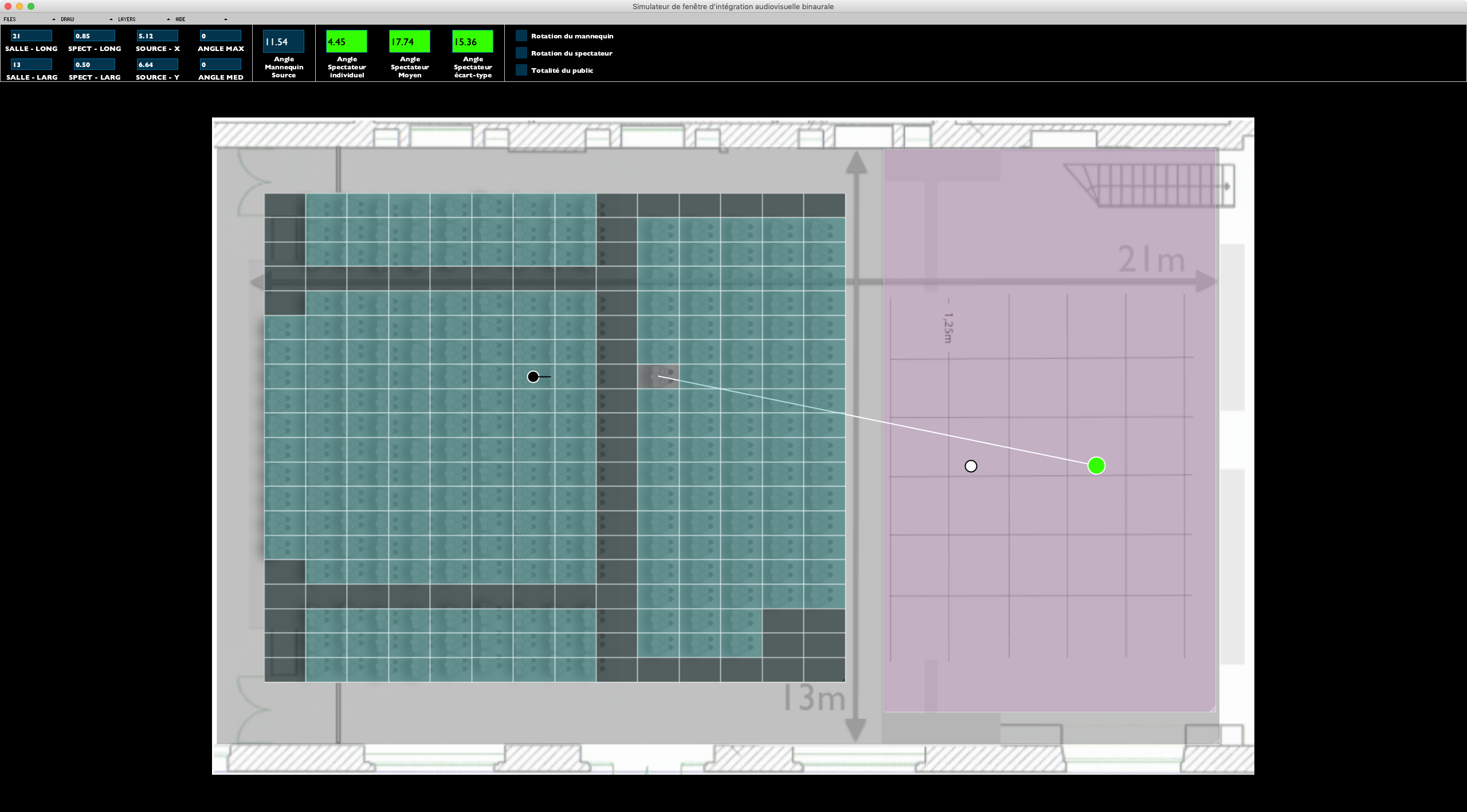

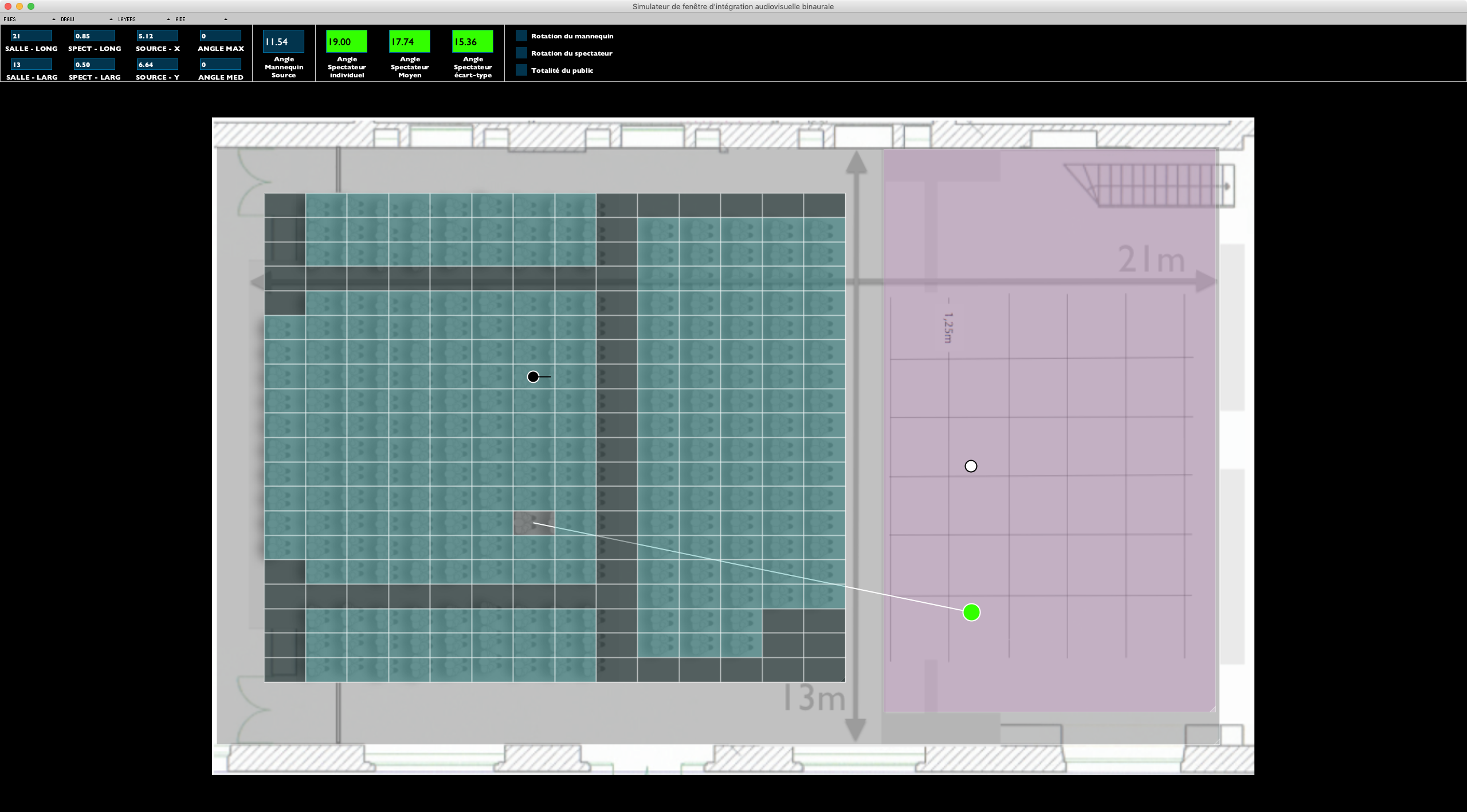

Le logiciel de simulation permet, à partir d’un plan de salle, de visualiser l’angle audiovisuel pour chaque spectateur, en fonction de la position du mannequin et de celle de la source sonore sur scène.

Le simulateur a été développé sous Processing par Rui Emmanuel Candeias, ingénieur Arts et Métiers, impliqué dans L’Examen Moyak.

Exemples

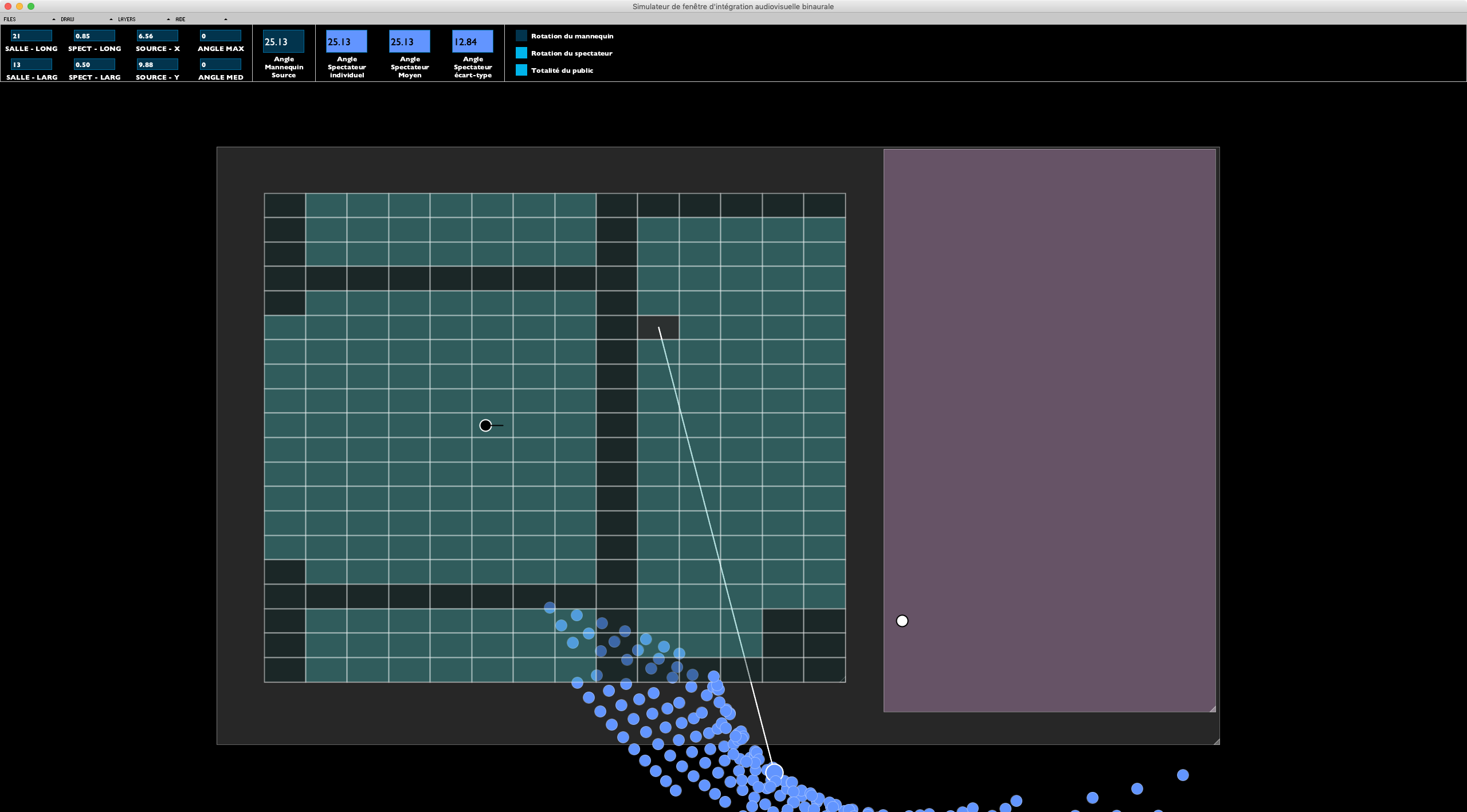

Ici, le mannequin (point noir dans les gradins ) regarde devant lui : le petit vecteur noir pointe dans l’axe de la salle.

Le point blanc représente la source sonore réelle sur scène, un acteur, par exemple, ou un instrument.

Les points bleus représentent la position de la source virtuelle pour chaque siège et chaque vecteur de translation. Une option du logiciel permet de choisir si le spectateur regarde ou non la source réelle.

Le survol avec la souris permet de faire apparaître le vecteur de chaque fauteuil.

- si le mannequin est placé à cet endroit (et bien sûr, le logiciel permet de lui faire changer de place) et regarde devant lui

- que la source sonore se tient sur scène à cour (indépendamment de sa composition fréquentielle)

- et que les spectateurs regardent la source sonore

- la constellation de points bleus montre la piètre distribution de la projection binaurale pour l’ensemble du public.

La disparité est importante : d’un spectateur à l’autre, la qualité d’expérience sera bien différente si la qualité d’expérience dépend d’une fusion audiovisuelle correcte. Par ailleurs, une bonne partie de l’auditoire percevra cette source virtuelle au-delà du mur à cour. Physiquement, c’est impossible et l’adhésion à l’illusion sonore sera probablement moindre.

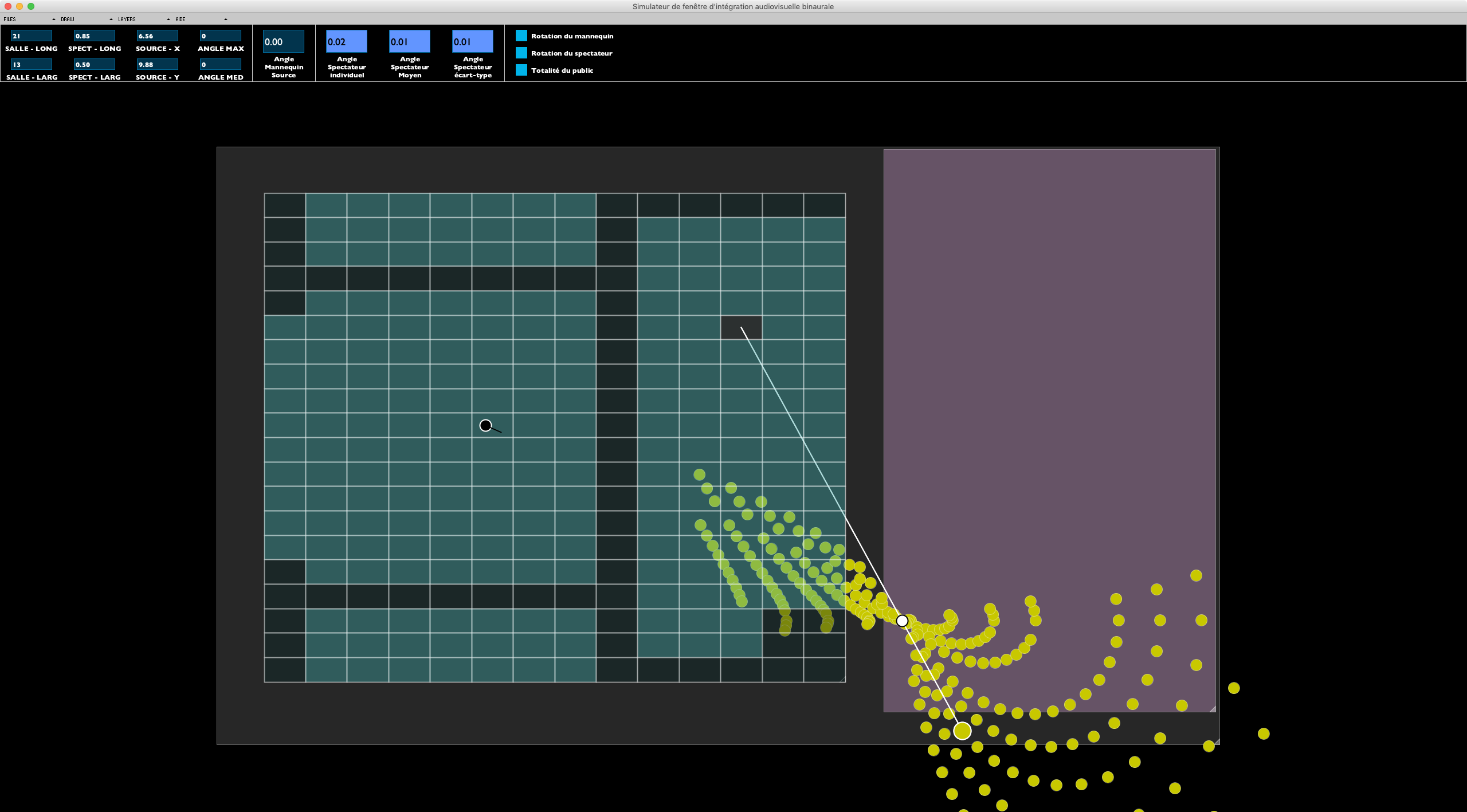

Cette fois, le mannequin regarde la source sonore : la distribution s’améliore nettement (les pastilles sont jaunes quand le mannequin regarde la source).

De là à motoriser le mannequin et à lui faire suivre la source (et quid s’il y en a plusieurs ?), il y a encore un fossé, mais c’est vrai qu’un spectateur suit de la tête et des yeux ce qui se passe sur scène, d’autant plus s’il en est proche.

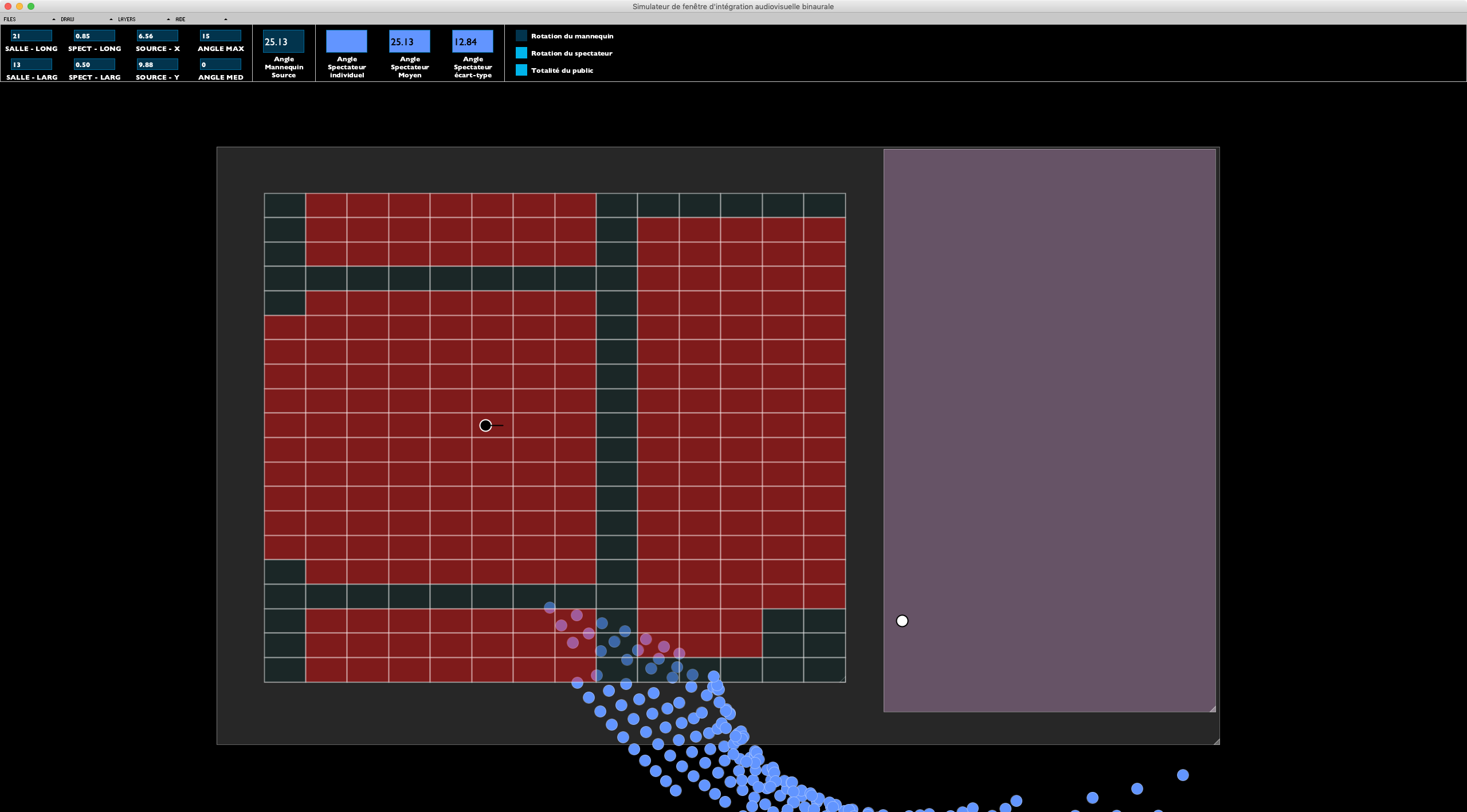

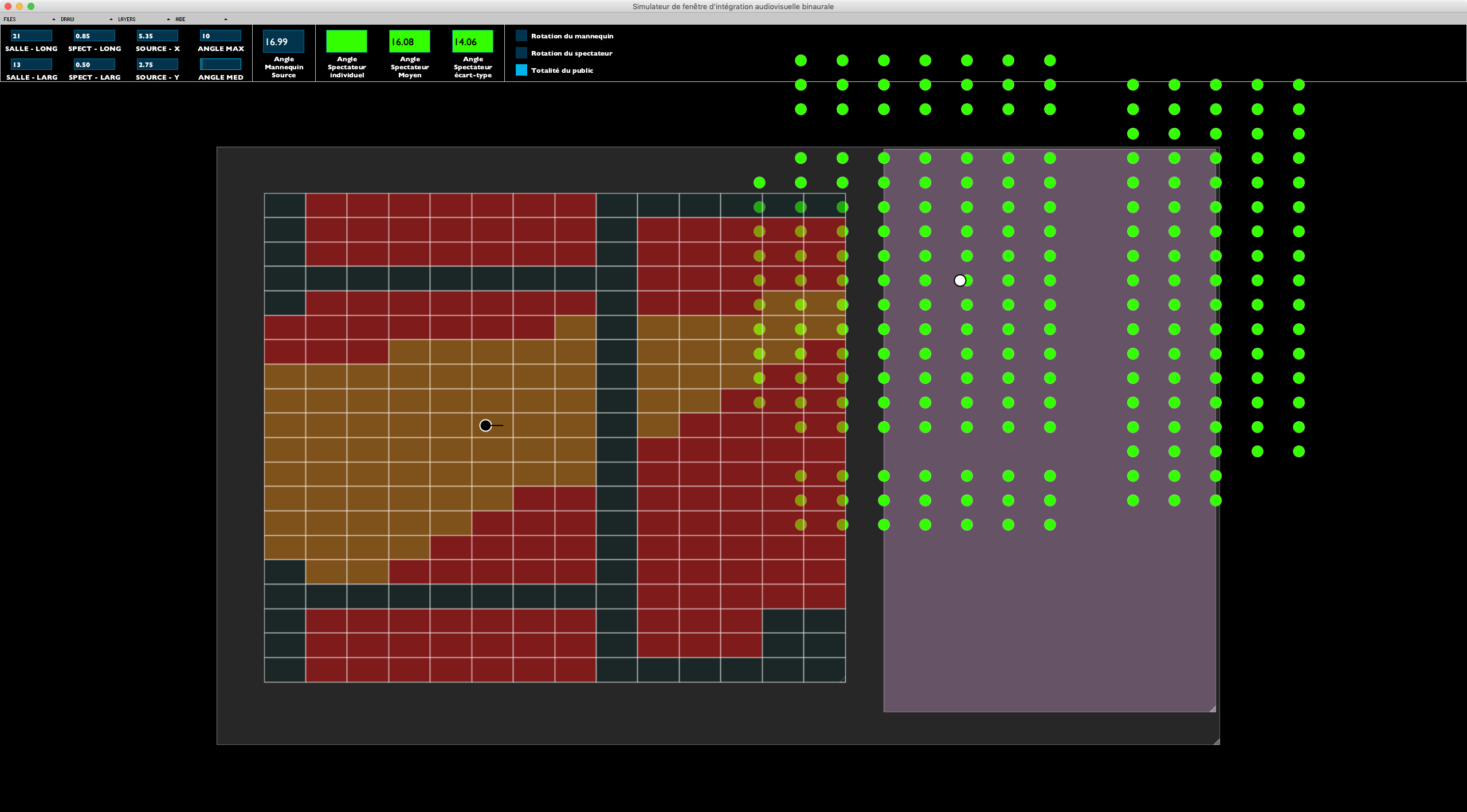

Il est aussi possible d’indiquer un angle limite au simulateur. En spécifiant un angle max de 15 degrés (sur la première capture d’écran), tous les fauteuils sont rouges. Aucun spectateur n’a de connexion audiovisuel avec un écart angulaire inférieur à 15 degrés entre les deux points de vue, sonore et visuel. La seconde capture montre la même configuration, mais pour des spectateurs qui ne tourneraient pas la tête vers la source sonore : une zone de connexion de meilleure qualité, en forme de cône dans l’axe mannequin-source, apparaît.

Conclusion

Au final, avec un seul mannequin, il s’avère impossible d’obtenir un faible écart angulaire pour tous. Si l’on s’en tient à des écarts max faibles (10-20 degrés), le nombre de spectateurs correctement servi est trop faible. C’est bien la largeur de la distribution du public qui pose problème :

- plus le spectateur est sur un côté du mannequin, plus le décalage angulaire augmente et moins bonne est la connexion audiovisuelle

- plus le spectateur est dans l’axe mannequin-scène, meilleure est la connexion

- la dispersion est plus favorable quand le mannequin regarde la source, mais ce constat n’a guère de solution pratique

En conséquence, pour améliorer la fenêtre de fusion audiovisuelle, il faudrait multiplier les mannequins et router leurs captations vers autant de bandes de spectateurs (pour cette salle, 5 ou 6 bandes)

Sinon, il faut déplacer les mannequins, probablement sur scène, et revoir l’usage

Le cas Moyak

Avec les mannequins dans les gradins, le live est capté par un voisin, un autre spectateur, quelque part dans la salle ; je peux jouer avec cette configuration, notamment par des événements dans les gradins. Les comédiens vont faire des allers-retours entre la scène et la salle.

Avec les mannequins sur scène, le live est capté depuis l’action ; le mannequin est une projection du spectateur sur le plateau, avec les comédiens autour de lui. Le spectateur est dans son fauteuil, mais son oreille est au plateau. Il y a toujours un gros décalage de la scène sonore par rapport au visuel, mais cette fois, elle est égocentrée.

Mais pour éviter des problèmes angulaires encore marqués, il faut probablement utiliser les mannequins de face, comme un micro standard devant le son. La projection du spectateur sur le plateau est un face à face.

Utiliser le mannequin comme un couple stéréo face à la source pourrait sembler contradictoire dans un contexte de production 3D. Mais finalement, cet axe sera réservé à la première partie du spectacle : la présentation de l’examen Moyak, émission d’audio réalité, qui justifie l’usage d’un son de face pour la présentatrice.

Sur plan plus technique, pour ce cas, mettre sur scène les mannequins peut être une bonne manière de concilier :

- le besoin d’un niveau sonore suffisant pour la captation du live ce qui ne serait pas forcément le cas avec des mannequins dans les gradins

- le besoin d’insérer des sources lead (le texte surtout) dans un mix préproduit et très externalisé et que le mix soit toujours parfaitement lisible (confort d’écoute à niveau réaliste)

- l’intérêt de composer avec les habitudes d’écoute et l’inscription culturelle de la voix de face pour un pastiche de télé-réalité (dans un spectacle déjà bien barré…)

- le coût économique de l’option il faut 8 mannequins dans ce spectacle…

- et enfin l’intérêt de la présence physique des mannequins : ils sont finalement présents sur scène, support de la transposition physique du spectateur et de ce point de vue subjectif

Nous avons opté pour cette solution.

Téléchargement

L’application est disponible ici.

Chaque zip contient l’application pour l’OS spécifié, la notice d’utilisation et un plan à l’échelle du théâtre du Champ au Roy, Guingamp (fourni à titre d’exemple).

Version Mac / Version Windows 32 bits / Version Windows 64 bits

1 commentaire

Salle Virtuelle Cotesdarmor Fr Rmx Connexion - ConnexionGuide.Com · 1 août 2021 à 20 h 53 min

[…] 10. Simulateur de projection – Expert en illusion sonore – Binaural.fr […]

Les commentaires sont fermés.